合同ゼミ2024発表(MIPLAB学生全員)

2024年7月7日に開催された 第11回 AI時代を担う世代による情報処理技術研究会 において,MIPLABのB4学生4名による研究発表が行われました.

発表報告

発表リスト

- 天田侑輝,``演技発話におけるx-vector埋め込みの可視化による感情と話者性の表現の検討''

- 仲田繁人,``歯ぎしり分類における有効な筋電信号選択のためのランダムフォレストによる特徴量選択''

- 岸本康汰,``シーン抽象度を変更可能な音響シーン分類のためのシーン種類数の増減と分類精度の分析''

- 鎌田輝夏,``歯ぎしりの分類における特徴量としての筋電信号の時間波形とスペクトログラムの比較''

概要

演技発話におけるx-vector埋め込みの可視化による感情と話者性の表現の検討(天田)

本研究では,感情と話者性の表現について検討した.データセットとして,広島市立大学の感情音声コーパスを用いた.3種類のx-vector埋め込みのモデル,t-SNEによる次元削減による可視化により,感情,話者性,演技技法,セリフそれぞれで分離できるか実験を行った.結果として,話者性の分離は見られた.感情,セリフで部分的な分離が見られた.演技技法では分離は見られなかった.また,3種類のx-vectorの各モデルによる違いも確認できた.

歯ぎしり分類における有効な筋電信号選択のためのランダムフォレストによる特徴量選択(仲田)

本報告では,筋電信号を用いて歯ぎしり分類を行ううえで,有効な特徴量について検討する.入力とする筋電信号の長さや分類クラス数を変化させて,歯ぎしりやその他の動きについてランダムフォレストを用いて推定を行った.推定の結果,5秒の信号を入力とした場合が最も推定精度が高くなることが分かった.推定に用いた特徴量の重要度の分析から,食いしばりを推定したい場合は頬のあたりの信号を,タッピングを推定したい場合は顎下あたりの信号を用いることが有効であることがわかった.

シーン抽象度を変更可能な音響シーン分類のためのシーン種類数の増減と分類精度の分析(岸本)

本研究では,音響シーン分類において,シーン抽象度に合わせて分類クラス数を調整することを目指す.本報告では,与えられた音データに対してクラス数を増減させ,それぞれの場合でシーン分類をおこない,その結果をもとにクラス数の変化と分類の識別精度の関係を分析した.結果から,クラス数を2から6まで増加させた場合は識別精度が徐々に低下したが, クラスを7以上に増やした場合, 識別精度には大きな差が見られなかった.

歯ぎしりの分類における特徴量としての筋電信号の時間波形とスペクトログラムの比較(鎌田)

本研究は,筋電信号を特徴量とした機械学習で,4種類の歯ぎしりと歯ぎしりの以外の動作を分類することを目的とする.本報告では,9チャネルの筋電信号を時間波形,メルスぺクトログラムに変換し,それぞれをMulti Layer Perceptron(MLP),Convolutional Neural Network(CNN) に入力して,4種類の歯ぎしりとその他の行動の5クラスの分類を行った.各方式の結果を比較すると,テストデータでは時間波形の方がわずかに出力データの正答率が高くなることが確認できた.

参考URL

- http://www.ls.info.hiroshima-cu.ac.jp/workshop/20240707/20240707kenkyuukai_top.html

- http://www.ls.info.hiroshima-cu.ac.jp/workshop/20240707/20240707kenkyuukai_prog.html

雑感(原)

この研究会は,広島市立大・広島経済大・津山高専・岡山大の関連研究室による合同ゼミとして開催されており, 今年は,聴講含めて50名超の参加者を擁する会となりました.

冒頭に一人1分の概要紹介をしてから,約80分のポスターセッションを行います. また,発表に先立って,4ページ以内の原稿も書いています.

研究発表自体が初めてのB4生には,いろいろと戸惑うことも多かったはずですが, 頑張って準備を進め,無事に発表を終えることができました.

特別研究を始めるにあたっての良いスタートダッシュが切れました. ここからはじっくりと研究を進めていけることでしょう.ご期待ください.

写真ほか

宮島開催ということで新幹線・在来線・フェリーを乗り継いでの旅になりました.

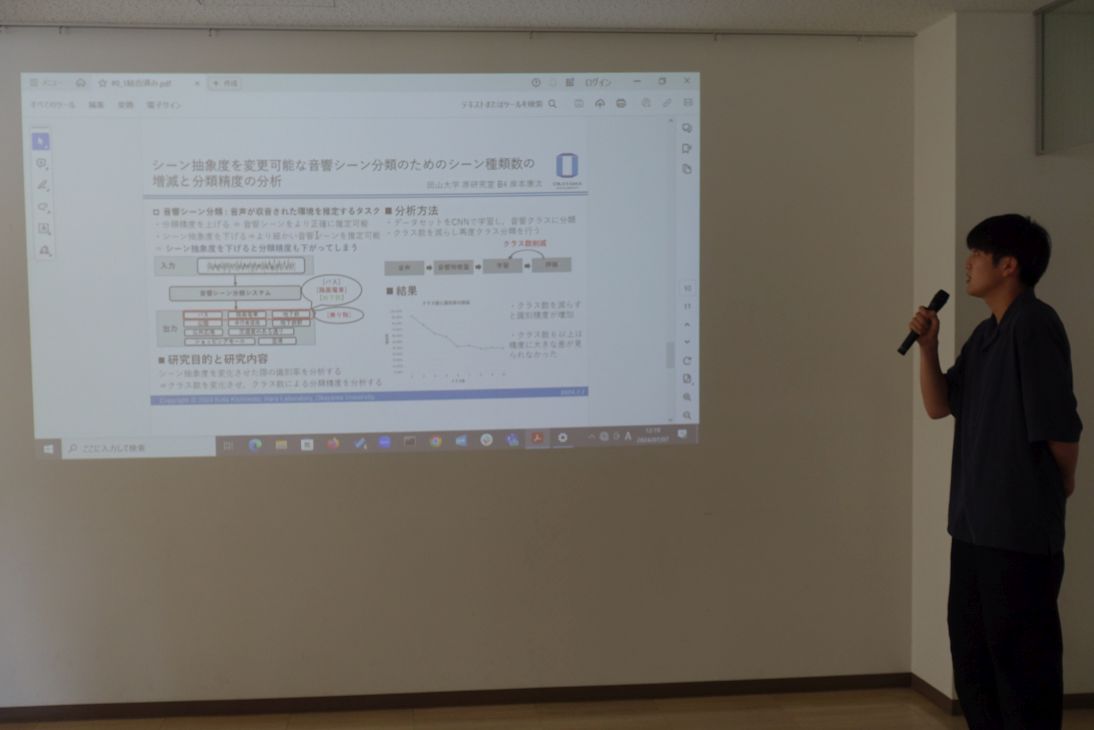

1分プレゼンテーションに挑んでいます.

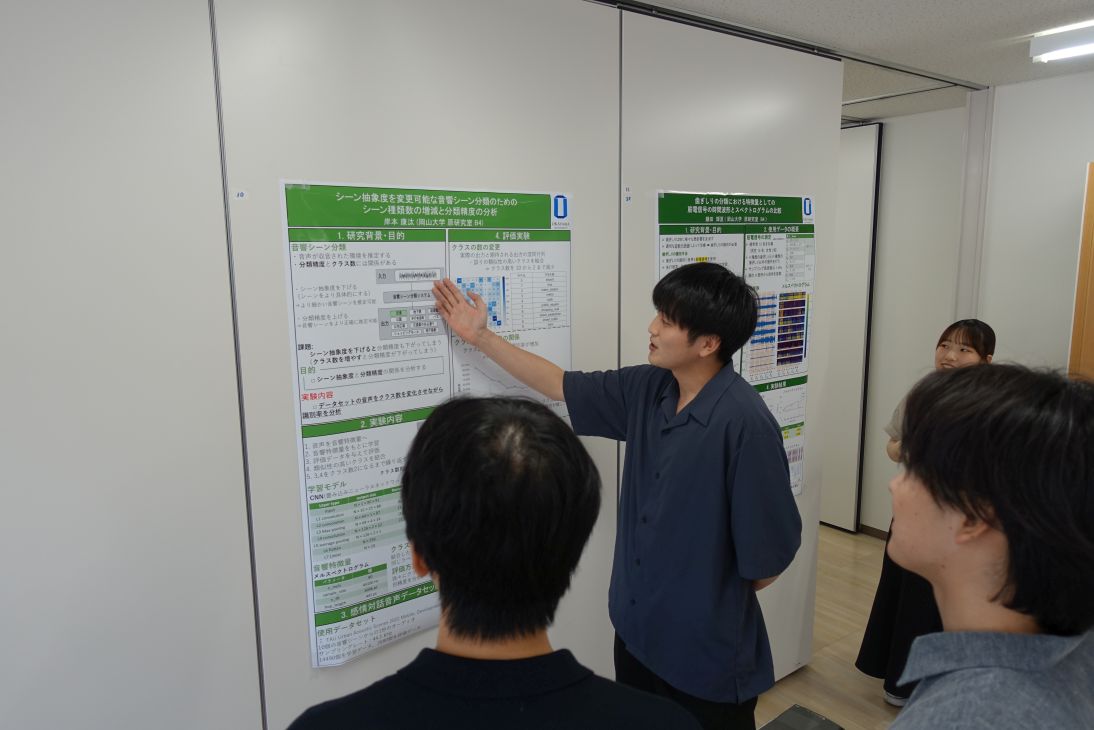

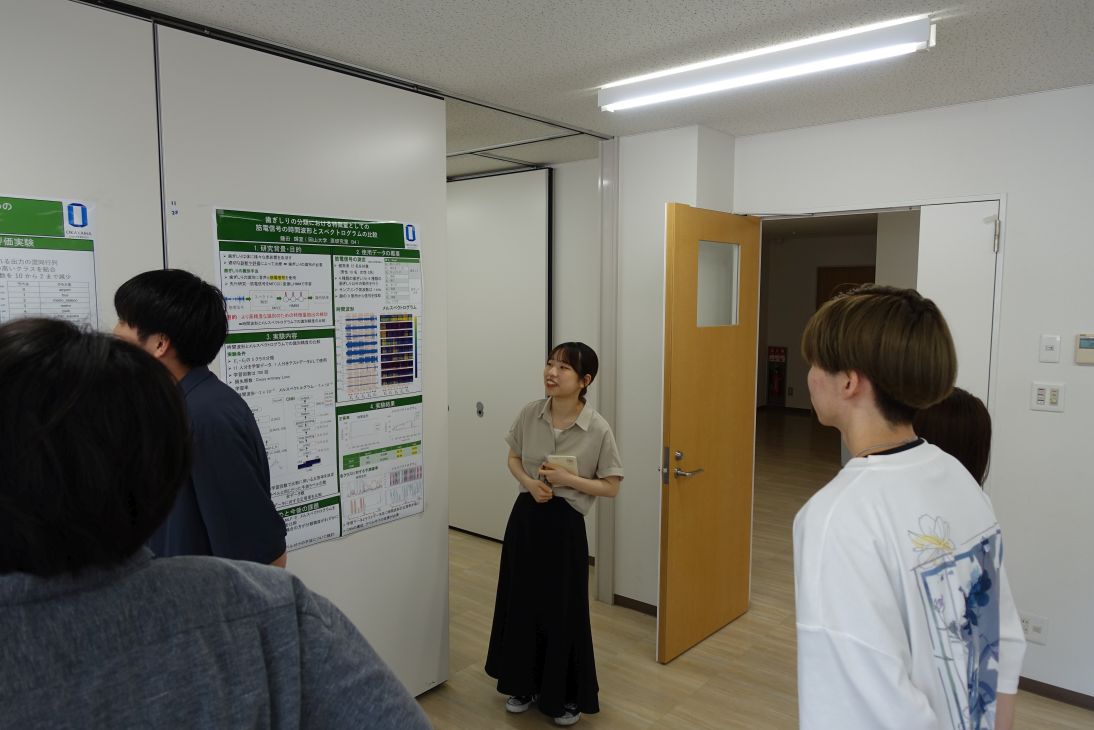

そして,ポスタープレゼンテーションへ...

最後は,懇親会にて他大学・他研究室の皆様や親睦を深めました. 皆様,ありがとうございました.